人机交互定义

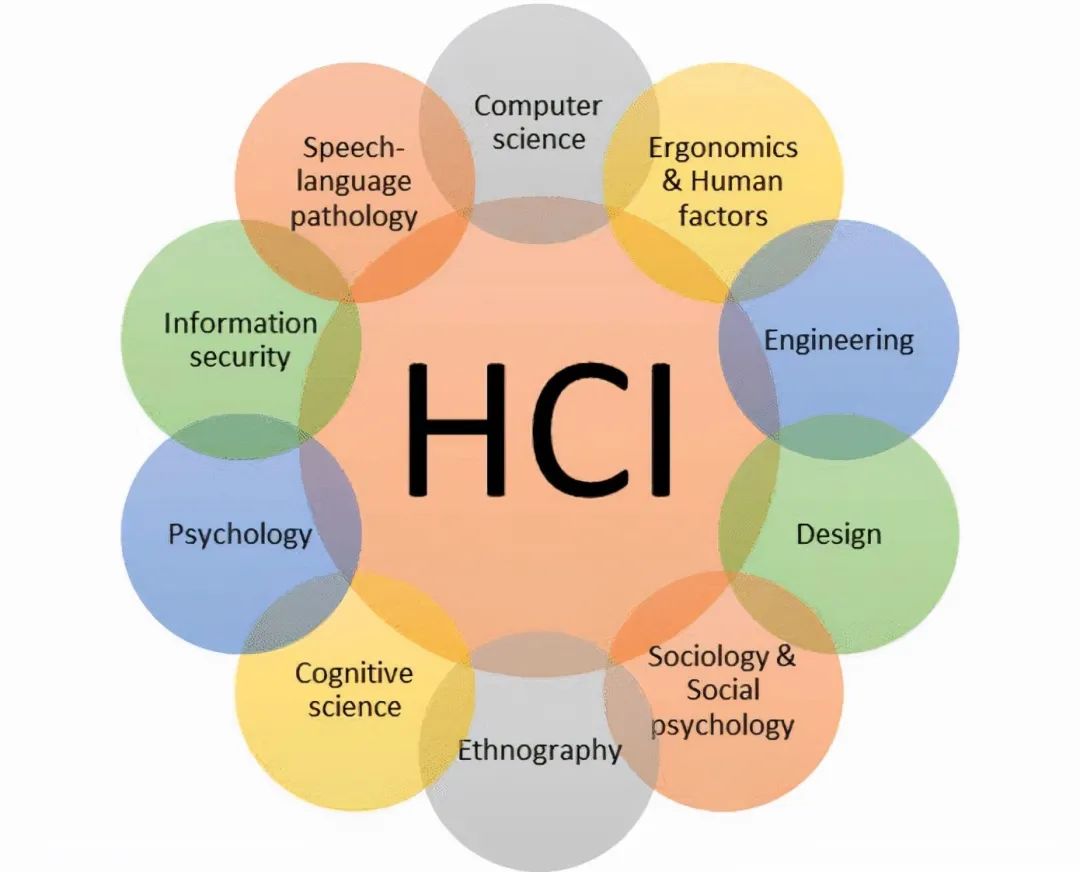

人机交互(Human-Computer Interaction, HCI),也称人机互动,是人与计算机之间为完成某项任务所进行的信息交换过程,是一门研究系统与用户之间的交互关系的学问。

人机交互关注的就是人、机器和交互三个部分。

人机交互涉及到计算机科学的多个学科方向,如图像处理、计算机视觉、编程语言等,以及人文学科的多个方向,如人体工程学、人因工程学、认知心理学等,还涉及相关专业领域知识。

人机交互发展历程

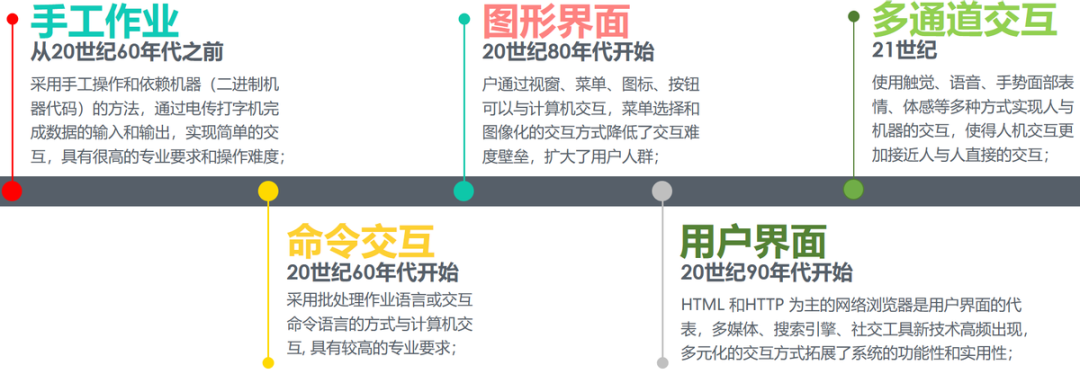

人机交互的发展历史,是从人类通过学习适应机器到机器不断地适应人类的过程,人机交互的发展降低了人类使用机器的学习时间和难度壁垒。主要经历了:

人机交互技术

目前,人机交互的技术有基于传统硬件设备的交互技术、基于语音识别的交互技术、基于触控的交互技术、基于动作识别的交互技术、基于眼动追踪的交互技术、基于多通道(多种感觉通道和动作通道,如语音、手写、姿势、视线、表情等输入)的交互技术等。下面就让我们来看看各种人机交互技术的实现效果。

基于传统硬件设备的交互技术

我们常用的鼠标、键盘、游戏手柄等都是常用传统硬件的交互技术,这种交互技术用户操作简单,需要外设支持,但不能为用户提供自然的交互体验。

基于语音识别的交互技术

随着人工智能语音识别技术的发展和商业落地,基于语音识别的交互技术已广泛的应用于我们的现实生活中,如Siri,Cortana等。

基于触控的交互技术

基于触控的交互技术目前已实现从单点触控发展到多点触控,实现了从单一手指点击到多点或多用户的交互的转变,用户可以使用双手进行单点触控,也可以通过识别不同的手势实现单击、双击等操作,如我们最常使用的苹果笔记本的触控区,手机的多点触控等。

基于动作识别的交互技术

基于动作识别的交互技术依赖于动作捕获系统获得的关键部位的位置进行计算、处理,分析出用户的动作行为并将其转化为输入指令,实现用户与计算机之间的交互。如Hololens、Leap Motion、Meta2等。

基于眼动追踪的交互技术

基于眼动追踪的交互技术是利用传感器捕获、提取眼球特征信息,测量眼睛的运动情况,估计视线方向或眼睛注视点位置的技术,通过获取人类眼球的运动信息,从而实现一系列的模拟、操纵功能。最常见使用眼动追踪交互技术的是VR领域。

基于多通道的交互技术

多通道交互涵盖了用户表达意图、执行动作或感知反馈信息的各种通信方法,如言语、眼神、脸部表情、唇动、手动、手势、头动、肢体姿势、触觉、嗅觉或味觉等。目前,使用的多通道交互技术包括手写识别、笔式交互、语音识别、语音合成、数字墨水、视线跟踪技术、触觉通道的力反馈装置、生物特征识别技术和人脸表情识别技术等方面。

人机交互研究趋势

借助AMiner平台分析近年来人机交互研究的热点有虚拟现实(Virtual Reality)、增强现实(Augmented Reality)、交互设计(Interaction Design)、视觉缺陷(Visual Impairment)、混合现实(Mixed Reality)、社会计算(Social Computing)、普适计算(Ubiquitous Computing)、眼动追踪(Eye Tracking)、信息可视化(Information Visualization)、众包(Crowdsourcing)。其中,虚拟现实、增强现实是未来的研究热点。

本文来源:北京誉华科技