在现代计算领域,CPU、GPU和TPU是三种关键的处理器类型,它们在性能和应用上各有千秋。

人工智能(AI)和机器学习(ML)技术的快速进步,我们的生活方式和工作模式正在经历一场革命。这些技术对计算资源的需求日益增长,推动了半导体行业的创新浪潮。

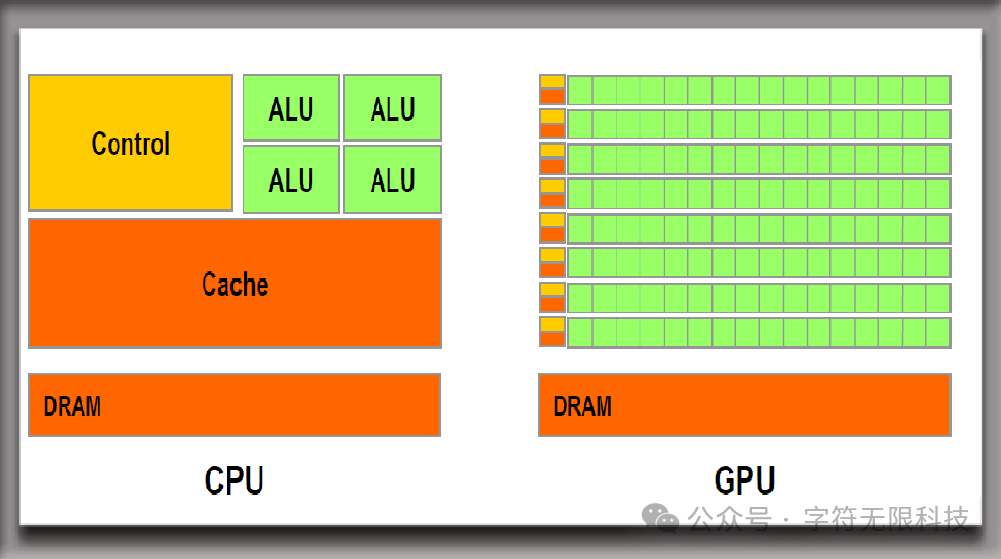

传统的中央处理器(CPU)虽然在处理通用任务方面非常高效,但在处理需要大量并行处理的AI应用时,其性能限制开始变得明显。

随着摩尔定律的放缓,仅仅通过提高CPU的时钟频率来增加计算能力的方法已经变得越来越不切实际。

为了克服这些限制,行业开始转向使用专门的硬件加速器,如图形处理器(GPU)和张量处理器(TPU)。

GPU以其出色的并行处理能力,在图像处理、科学研究和深度学习等领域表现出色。

TPU则是为机器学习任务量身定制的,特别擅长处理机器学习算法中常见的矩阵运算和卷积神经网络。

通过将这些专用加速器与CPU结合使用,可以显著提高系统处理AI任务的能力,从而满足日益增长的计算需求。

这种协同工作的方式,不仅提升了性能,也为AI技术的发展和应用开辟了新的可能性。

在计算领域,三大主要处理单元:TPU(张量处理单元)、CPU(中央处理单元)和GPU(图形处理单元)处理单元都有其独特的设计理念和功能特点,使其在不同任务中展现出显著优势,并被广泛应用于各种计算需求中。

什么是TPU?

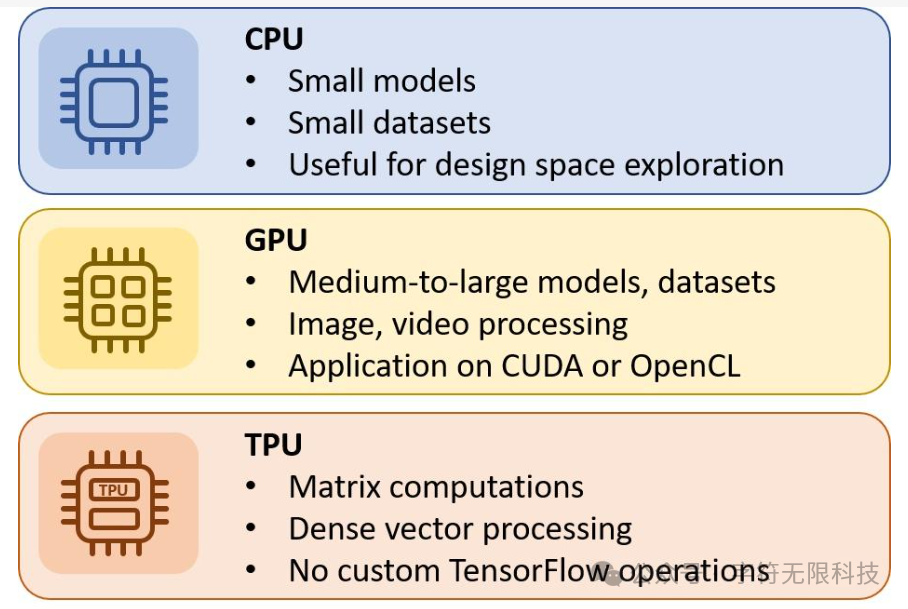

TPU,即张量处理单元,是由谷歌公司为提升机器学习任务的效率而特别研发的专用处理器。这种芯片的设计初衷是为了满足深度学习算法在计算上的需求,特别是在执行大规模并行张量运算方面表现出色。

它特别擅长快速进行矩阵乘法运算,这种运算在深度学习算法和神经网络的构建中非常关键。由于这种优化,TPU在处理需要大量计算资源的深度学习模型时,能够提供显著的性能提升。

与通用的CPU相比,TPU在执行特定的人工智能任务时,能够实现更高的效率,特别是在需要处理大量数据集进行模型训练和预测的场景中。

这种专用的硬件设计,使得TPU成为促进深度学习技术进步的重要工具,它广泛应用于大型企业AI解决方案和云服务提供商的机器学习平台中。

TPU通过其专门化的计算能力,为深度学习领域的研究和应用提供了强大的支持。

什么是CPU?

CPU,也就是中央处理单元,是计算机硬件的心脏,它扮演着“全能选手”的角色。以其多功能性而闻名,CPU能够处理各种计算任务,包括操作系统的运行、硬件资源的管理,以及执行复杂的数学运算和算法。

CPU在性能与能耗之间取得了良好的平衡,这使得它能够适应多种不同的场景。

尽管CPU在处理单个任务时表现出色,但在面对需要大量并行处理的任务,如深度学习等,其效率可能不如GPU和TPU。

这是因为GPU和TPU在设计时就特别考虑了并行处理的需求,因此在这类任务上能够提供更高的计算效率。

总之,CPU是一个多才多艺的处理器,适合处理广泛的任务,但在特定的并行计算密集型应用中,可能需要GPU或TPU这样的专用硬件来实现更优的性能。

什么是GPU?

GPU,即图形处理单元,最初是为提升图形渲染性能而开发的。但随着技术的发展,人们发现GPU的并行处理能力在多个领域都具有巨大的潜力,因此它已经从一个专门的图形渲染设备转变为一个多用途的计算加速器。

GPU能够同时处理大量的数据流,这使得它在执行需要大规模并行处理的任务时表现出色,例如视频编辑、3D 渲染、科学计算、加密货币挖掘以及人工智能训练。

在需要处理大量数据并行运算的场景中,GPU的效率和性能通常远超传统的CPU。

GPU的并行处理特性使其成为处理复杂并行计算任务的理想选择,尤其在数据密集型应用中,GPU提供了显著的性能优势。

TPU、CPU 以及 GPU 的价值效应?

在现代计算系统中,TPU、CPU 以及 GPU 虽然各有其独特的优势与劣势,但它们通常在特定应用场景中相互补充,共同作业。

这种协同作用允许计算系统根据任务需求,将不同处理器的优势结合起来,以应对各种复杂的工作负载,从而提高整体的性能和效率。策略使得计算系统能够灵活地分配和利用资源,以优化处理速度和效果。

TPU(张量处理单元)是为机器学习任务量身定制的硬件加速器,它在执行深度学习中的大规模并行矩阵运算方面表现出色,这使得TPU在深度学习的工作流程中发挥着关键作用。

由于深度学习通常涉及到对庞大神经网络的训练和对海量数据的处理,TPU的专门优化架构能够显著提高训练速度,减少模型更新的时间。

这种计算上的优势让TPU在需要高效并行处理的深度学习任务中变得不可或缺。

与此同时,CPU(中央处理单元)作为计算机系统的核心,负责协调和管理整个训练过程。CPU的多功能性使其能够处理各种系统级的任务,如操作系统的维护、数据的调度、任务的分配以及执行复杂的指令。

尽管CPU在并行处理方面可能不如GPU和TPU那样高效,但其在大多数计算场景中的通用性和对多种计算需求的适应性仍然是不可或缺的。

在实际的应用场景中,GPU(图形处理单元)以其强大的并行处理能力而著称。特别是在需要实时推理和图像处理的任务中,GPU的优势尤为显著。其并行化的架构允许同时处理大量的数据流,特别适合于那些需要高吞吐量和低延迟的应用。

GPU不仅在深度学习的推理阶段表现出色,还在图形密集型的操作、3D渲染、视频处理等任务中扮演着核心角色,使其成为游戏、虚拟现实以及加密货币挖掘等应用中的关键计算组件。

在游戏或虚拟现实等应用中,GPU的实时渲染能力对于提供高质量的图形体验和处理复杂的视觉效果至关重要。

同时,CPU则负责处理物理计算、游戏逻辑、AI行为等后台任务,确保游戏的流畅运行。在一些涉及机器学习的应用程序中,如自适应游戏AI或实时优化算法,TPU也可以被用来加速特定的深度学习推理任务,从而提升系统的智能处理能力。

简而言之,CPU、GPU和TPU在现代计算系统中各司其职,相互配合,以满足不同的计算需求。

将 TPU、CPU 以及 GPU 组合在一个计算系统中,为开发人员和研究人员提供了灵活性,使他们能够根据工作负载的具体需求,智能地分配任务,从而充分利用每个处理器的优势。这种协同作业策略构建了一个更加均衡和高效的计算环境。

例如,在训练复杂的AI模型时,可以利用TPU的并行处理能力来处理深度学习任务,CPU则负责整体的系统管理与任务调度,而GPU则专注于执行需要快速响应的推理任务或图像处理工作。

这种优化的任务分配不仅提升了系统的运行速度,还实现了性能和能源效率的显著提升。多处理器的集成使用,通过合理分配工作负载,实现了计算资源的最大化利用和系统性能的优化。

综合来看,TPU、CPU和GPU各自拥有独特的长处和适用领域。

TPU专门针对机器学习任务进行优化,以加速学习过程;CPU则提供广泛的多功能计算能力,适用于各种计算任务;GPU则在处理需要大规模并行计算的任务时表现出极高的效率。

根据特定的工作负载和计算需求,恰当地选择并利用这些处理器,可以极大地增强系统的性能和效率。

简而言之,通过智能地搭配这些处理单元,可以优化计算资源的使用,实现更高效的工作流程。

本文转自:字符无限科技,转载此文目的在于传递更多信息,版权归原作者所有。如不支持转载,请联系小编demi@eetrend.com删除。