作者:Nico Klingler

编译:ronghuaiyang

导读

在许多计算机视觉应用中(例如机器人运动和医学成像),需要将多个图像的相关信息整合到单一图像中。这种图像融合可以提供更高的可靠性、准确性和数据质量。

多视图融合可以提高图像分辨率,并恢复场景的三维表示。多模态融合则是将来自不同传感器的图像结合起来,也称为多传感器融合。其主要应用包括医学影像、监控和安全等领域。

图像融合的层级

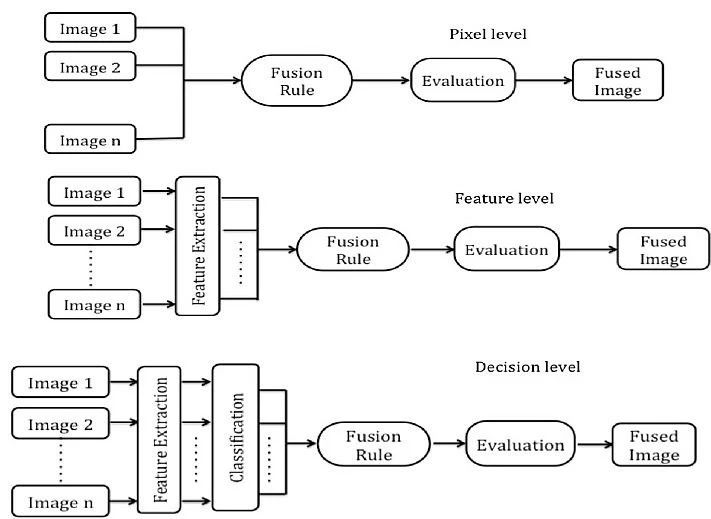

工程师根据融合实现的阶段将图像融合 (IF) 分为三个层级。

- 像素级 IF。这是一种低级别的图像融合方法,操作简单。它包含了两个输入图像的特征,并生成一个平均的、单一的结果图像。

- 特征级 IF。它从多个来源提取图像特征(如大小、颜色),并在特征提取后生成增强的图像。

- 块(区域)级 IF。这是一种高级技术。它利用多阶段表示法,并根据区域计算测量值。

图像融合的类型

单传感器 IF

单传感器图像融合捕捉真实世界的一系列图像。算法将一组图像组合起来,生成一个新的具有最佳信息含量的图像。例如,在不同的光照条件下,人类操作员可能无法检测到物体,但在融合后的图像中却能突出显示这些物体。

这种方法的缺点是所使用的成像传感器在某些传感区域存在局限性。在传感器能力限制系统功能(如动态范围、分辨率等)的情况下。例如,某些传感器适合光照环境(如白天),但不适合夜间和雾天条件。

多传感器 IF

多传感器图像融合方法将来自多个传感器的图像合并形成复合图像。例如,红外相机和单独的数码相机各自产生它们自己的图像,通过合并,最终生成融合图像。这种方法克服了单传感器的问题。

这种方法从多个图像中生成合并的信息。数码相机适合于白天条件;红外相机在弱光环境下表现良好。因此,这种方法在军事领域以及对象检测、机器人和医疗成像中都有应用。

多视图 IF

在这种方法中,图像具有多个或不同的视图。这种方法利用了来自不同条件下的图像,如可见光、红外、多光谱和遥感图像。常见的图像融合方法包括对象级融合、加权像素融合和变换域融合。

多焦点 IF

这种方法处理来自 3D 视角的图像及其焦距。它将原始图像分成若干区域,使得每个区域在图像的一个通道中都是清晰的。

如何实现图像融合?

研究人员以多种方式实现图像融合,这里我们介绍最常见的几种方法。

卷积神经网络

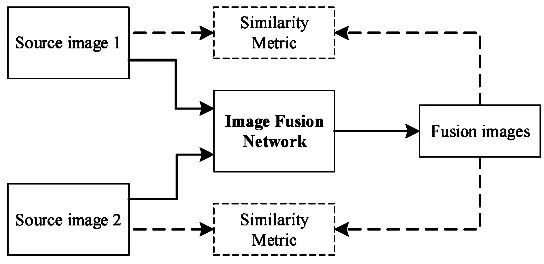

Zhang 等人 (2021) 创建了一个基于卷积神经网络 (CNN-based fusion) 的框架,通过精心设计的损失函数来提取特征和重建图像,他们利用卷积神经网络作为整个融合框架的一部分来进行活动级别监控和特征整合。

在他们的 CNN 融合案例中,他们将损失函数与分类 CNN 结合起来进行医学图像融合。此外,他们将融合层嵌入到训练过程中。因此,CNN 减少了手动设计的融合规则(最大值、最小值或平均值)带来的约束。

此外,研究人员还介绍了其他方法:

- 基于卷积神经网络的端到端融合框架,以避免手动规则的缺点。

- 他们的卷积神经网络定义了更精确且能更好地保留纹理结构的图像融合的目标函数。

- Zhang 等人通过梯度保留来建模图像融合,从而为多种融合任务设计了一个通用的损失函数。

多尺度变换

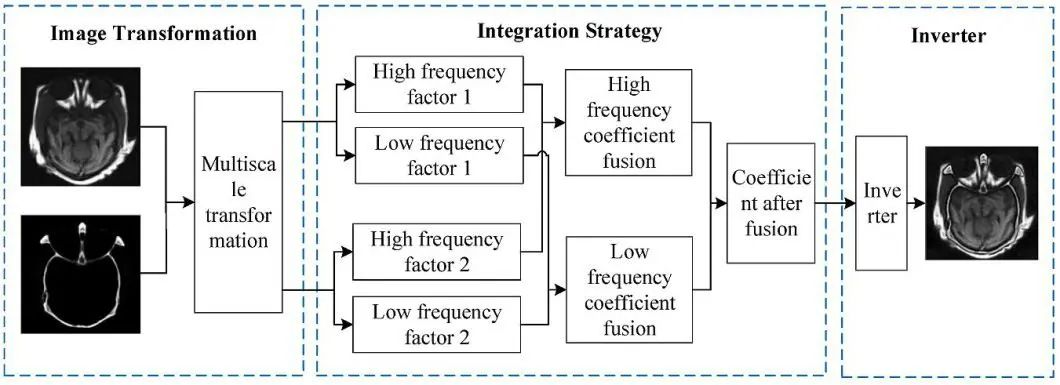

Ma 等人 (2023) 使用多尺度变换进行了 融合过程:

1. 他们分别分解图像,以获得不同的频率层次,即高频和低频子带。

2. 团队设计了最优融合计算方法作为融合策略。他们利用了高频和低频子带的不同特性。

3. 为了生成融合图像,他们反转了最终的融合系数。

- 研究人员在多个尺度和多个方向上应用了小波变换和几何变换,而无需进行子采样。

- 他们的基于多尺度变换的融合方法根据不同子带的特性引入了融合策略。因此,融合图像富含详细信息且冗余较低。

- 分解方法的选择和融合规则是融合过程的重要组成部分。它们决定了融合图像是否能包含比原始图像更多的信息。

基于稀疏表示的图像融合模型

与传统的多尺度变换相比,稀疏表示有两个主要区别。多尺度融合方法使用预设的基础函数,这忽略了源图像的一些重要特征。稀疏表示则是在一个完整的特征集上进行学习,可以更好地表达和提取图像。

此外,基于多尺度变换的融合方法将图像分解为多层,但对噪声和配准的要求相当严格。稀疏表示使用滑动窗口技术将图像分割为多个重叠段,从而提高了鲁棒性。

图像融合的应用

图像融合的主要应用场景有四个:

机器人视觉

机器人的运动利用了红外和可见光图像的融合。机器人使用红外图像来区分目标和背景,因为它们之间的热辐射差异。因此,光照和天气条件不会影响融合。然而,红外图像并不提供纹理细节。

对于他们的计算机视觉任务,机器人使用可见光图像。由于受到数据收集环境的影响,可见光图像可能无法显示重要的目标。红外和可见光融合方法克服了单个图像的这一缺点,从而提取信息。

融合图像通常比红外图像更清晰。此外,机器人会进行可见光和红外图像的融合,比如用于自动驾驶和面部识别。

医学影像

如今,医学影像产生了多种类型的医学图像,以帮助医生诊断疾病或伤害。每种类型的图像都有其特定的强度。因此,图像融合在医学影像模式领域具有很高的临床应用价值。

医学影像研究人员将来自不同医学图像的冗余信息和相关信息结合起来,创建融合医学图像。这样他们为医学检查提供了高质量的信息启发式图像诊断。

该图展示了通过结合计算机断层扫描 (CT) 和磁共振成像 (MRI) 进行医学诊断的图像融合示例。数据来自一个结合了断层扫描和磁共振成像的大脑图像数据集(MedPix 数据集)。

医生使用 CT 来分析具有高空间域分辨率的骨骼结构,并使用 MRI 来检测软组织,如心脏、眼睛和大脑。通过图像融合技术将 MRI 和 CT 结合起来,以提高准确性和医学适用性。

工业中的缺陷检测

由于工业生产条件的限制,工件缺陷难以避免。典型的缺陷包括工件内部的碎屑、孔隙和裂纹。

这些缺陷在工件使用过程中会增加,影响其性能。因此,它们会导致工件失效,缩短其使用寿命,并威胁到机器的安全。

当前的缺陷检测算法一般分为两大类:

缺陷区域分割,其中所有潜在的缺陷区域从单一图像中被分割出来。

为了检测不同类型缺陷 —— 应用人工设计的特征。这些特征只适用于特定的缺陷检测,例如缺陷的大小、多样的形状和复杂的背景区域。

农业遥感

图像融合技术也被广泛应用于农业遥感领域。通过使用农业遥感技术,农民可以选择适合植物生长的环境并对植物疾病进行检测。

现有的融合技术,包括测距和光学检测设备、合成雷达以及中分辨率成像光谱仪等,都在图像融合中有所应用。

研究人员利用基于区域的融合方案来结合全色、多光谱和合成孔径雷达图像。此外,一些农民还会结合光谱信息、雷达距离数据和光学检测。

图像融合的优点和缺点

图像融合的优点

图像融合的好处包括:

- 图像融合减少了数据存储和数据传输的需求。

- 图像融合的成本相对较低,执行融合步骤简单。

- 团队使用图像融合进行图像识别和配准。

- 可以从多尺度的雾状图像中产生高分辨率输出。

- 融合结果图像易于解释,可以是彩色的。

- 它增加了情境和条件感知。

- 图像融合使人们能够从不同图像中读取小的符号(应用)。

- 从不同视角进行图像增强可以带来更好的对比度。

图像融合的缺点

图像融合存在一定的局限性,例如:

- 当图像模糊时,数据处理速度较慢。

- 由于特征提取和整合步骤,融合有时会变得复杂且成本高昂。

- 为每个应用场景定义和选择合适的特征需要时间和精力。

- 在图像融合过程中,有很大概率会发生信息丢失。

- 在单传感器融合中,图像在恶劣天气条件下可能会变得模糊。

- 在夜间条件下拍摄的照片中,进行图像融合较为困难。

- 为了获得良好的图像可视化效果,通常需要多传感器或多视图融合。

总结

图像融合是一项重要的技术,用于集成和评估来自多个来源(传感器)的数据。它在计算机视觉、医学影像和遥感等领域有着广泛的应用。带有复杂非线性失真的图像融合有助于提高最复杂的计算机视觉方法的鲁棒性。

本文转自:AI公园,转载此文目的在于传递更多信息,版权归原作者所有。如不支持转载,请联系小编demi@eetrend.com删除。