来源: 图形学与几何计算

近期,清华大学图形学实验室的博士后黄石生、助理研究员穆太江等和香港城市大学傅红波教授合作,提出了一种基于超体素卷积的在线三维语义分割的方法,该方法在在线场景下的三维语义分割准确性、效率性两方面达到了当前最好的水平,相关研究论文已被ACM Transactions on Graphics录用[1], 将于ACM SIGGRAPH ASIA 2021上报告。

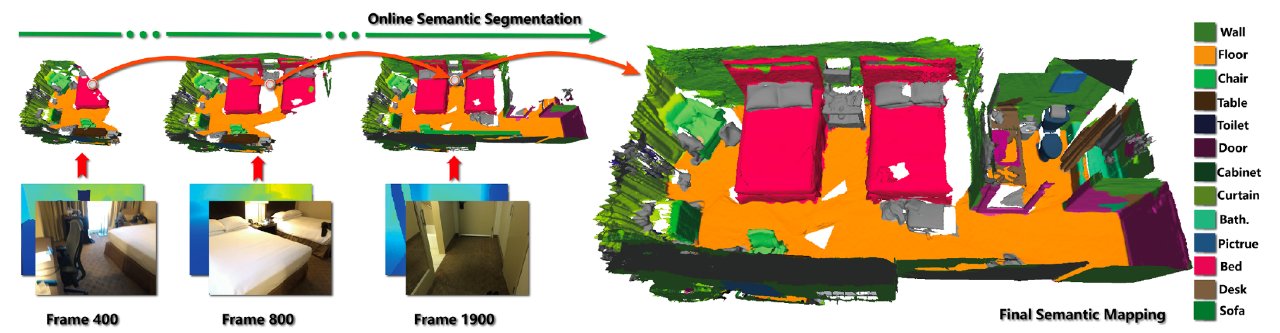

三维场景的在线三维语义分割(图1)是计算机图形学、计算机视觉和智能机器人研究领域中对于三维场景感知和理解的关键基础技术,具有非常广泛的应用前景。现有方法大多将利用2D卷积神经网络从图像提取的语义信息映射到三维场景,并结合贝叶斯优化策略进一步改进语义分割的结果。

但是,这些方法存在两个固有缺陷:

(1)无法充分挖掘2D和3D特征域上的深度学习特征,导致最终三维场景语义分割的准确率不高;

(2)深度学习的元数据表示能力不强,组织效率不高,不能有效的支持在线的三维语义分割。

为了解决上述问题,该论文创新性地提出一种基于超体素卷积的在线三维语义分割方法。具体而言,该方法首先提出使用结构保持的超体素(Supervoxel)作为紧致的深度几何学习元数据形式,并提出了超体素的卷积方式和基于超体素卷积的语义分割深度神经网络;进一步,在语义分割深度神经网络基础上,提出了高效、准确的在线三维场景语义分割算法。

Part1、超体素卷积

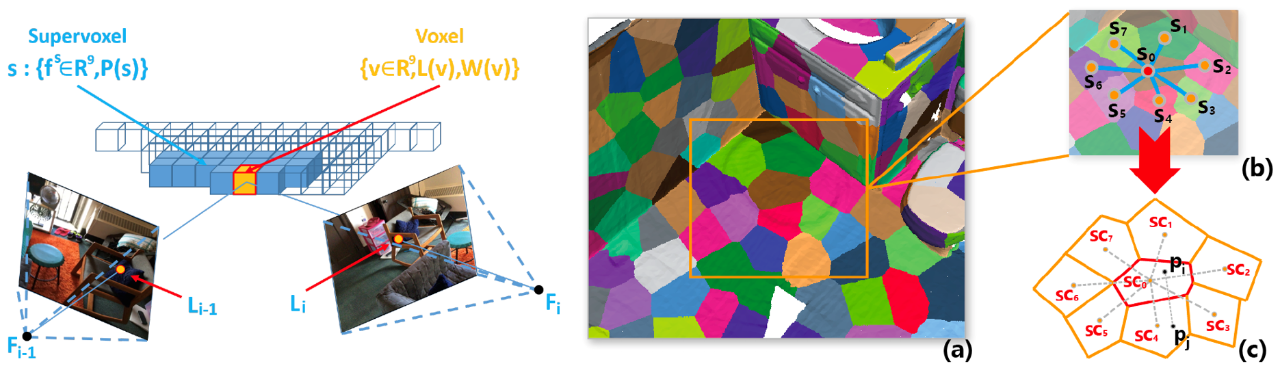

超体素是由一些相邻的物体表面体素(Voxel)组成的体素集合,如图2(左)所示,是一种紧凑的体素数据表示形式,可作为元数据输入到深度神经网络中进行语义预测,尤其适合在线任务的深度学习过程。该方法提供的增量式超体素聚类方法,不仅可以有效地将物体表面体素聚类起来,还能支持快速查询体素到超体素(voxel-to-supervoxel)的索引信息和超体素与超体素之间(supervoxel-to-supervoxel)的邻接信息,使得超体素卷积操作成为可能。

但是,如何在超体素上进行卷积,还是一个未定义的问题,主要需要解决两个难点:

1) 如何定义超体素的位置表示,从而支持卷积核函数的定义;

2)如何定义超体素的特征表示,从而支持通过卷积神经网络学习到有效的深度特征,进行语义预测。

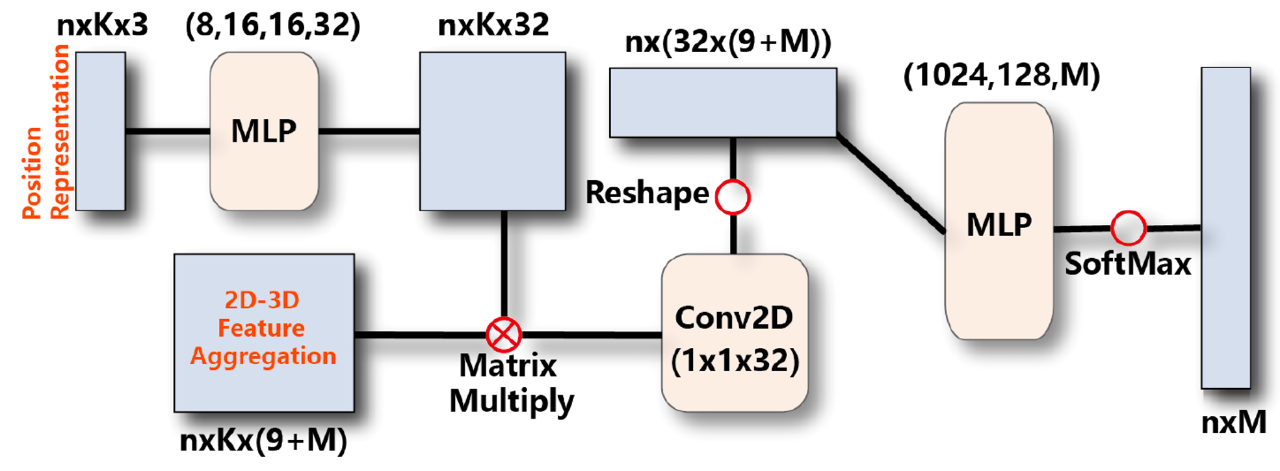

为此,该方法首次创新性地提出超体素的卷积方式(如图2(右)所示),并基于超体素卷积提出2D-3D跨域联合学习的语义预测网络Supervoxel-CNN(如图3所示),实现准确的三维语义预测。

Part2、基于超体素卷积的在线三维语义分割

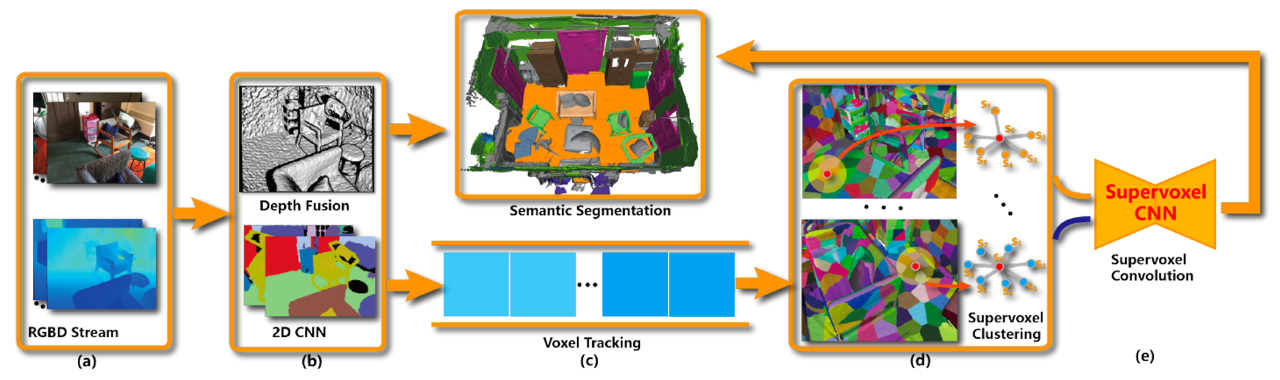

在超体素卷积网络Supervoxel-CNN的基础上,作者提出了在线的三维语义分割算法,其算法流程如图4所示。

具体而言,本算法包含一个基于VoxelHash[2]的实时三维重建模块,用于实时地对相机位姿进行估计和场景的几何重建。与此同时,使用SSMA网络[3]提取RGB-D图像的2D语义标签,并根据相机位姿投射到重建好的场景几何上;而所有体素的SDF值、语义标签以及权重等信息将相应更新,为超体素卷积做特征聚合准备。

另一方面,本算法不断对超体素进行卷积预处理,并结合“超体素-超体素”邻接信息进行超体素卷积操作。最后,每个超体素连同聚合特征被送入训练好的Supervoxel-CNN进行语义标签预测,超体素中所有的体素将会统一赋予所在超体素的语义标签。

Part3、实验与评测

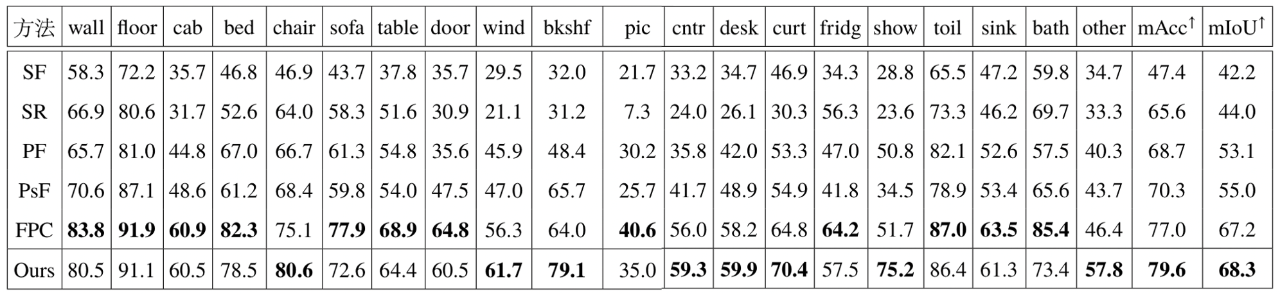

本工作将所提出的方法与已有的方法,包括SemanticFusion(SF)[4]、Semantic Reconstruction(SR)[5]、PF[6]、Progressive Fusion(PsF)[7]和FA-PConv(FPC)[8]等,进行定量比较实验。

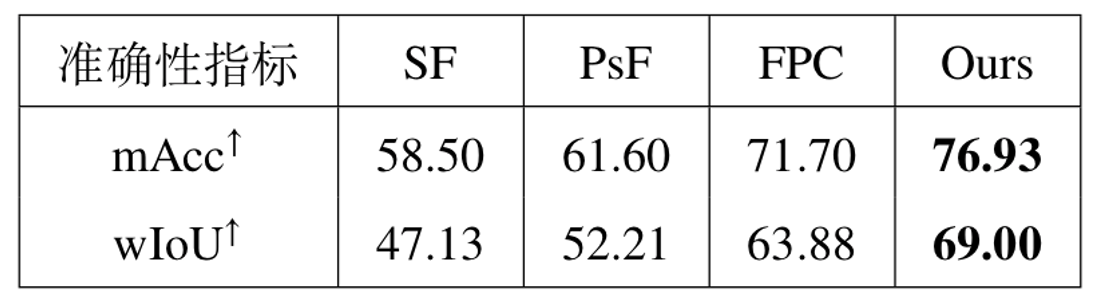

实验采用公开的真实场景扫描数据ScanNet数据集和SceneNN数据集,并对最终三维语义分割结果采用mAcc和mIoU准确性指标进行评测。表1和表2分别统计了以上几种方法在ScanNet数据集和SceneNN数据集上的准确性指标。

在两大公开数据集上的评测表明,本工作所提方法能获得更准确的三维语义分割结果,特别指出的是该方法比传统方法(如SF、SR、PF、PsF等)在两种准确性指标上均有接近或超过10个点的提升,最大提升可达32个点。

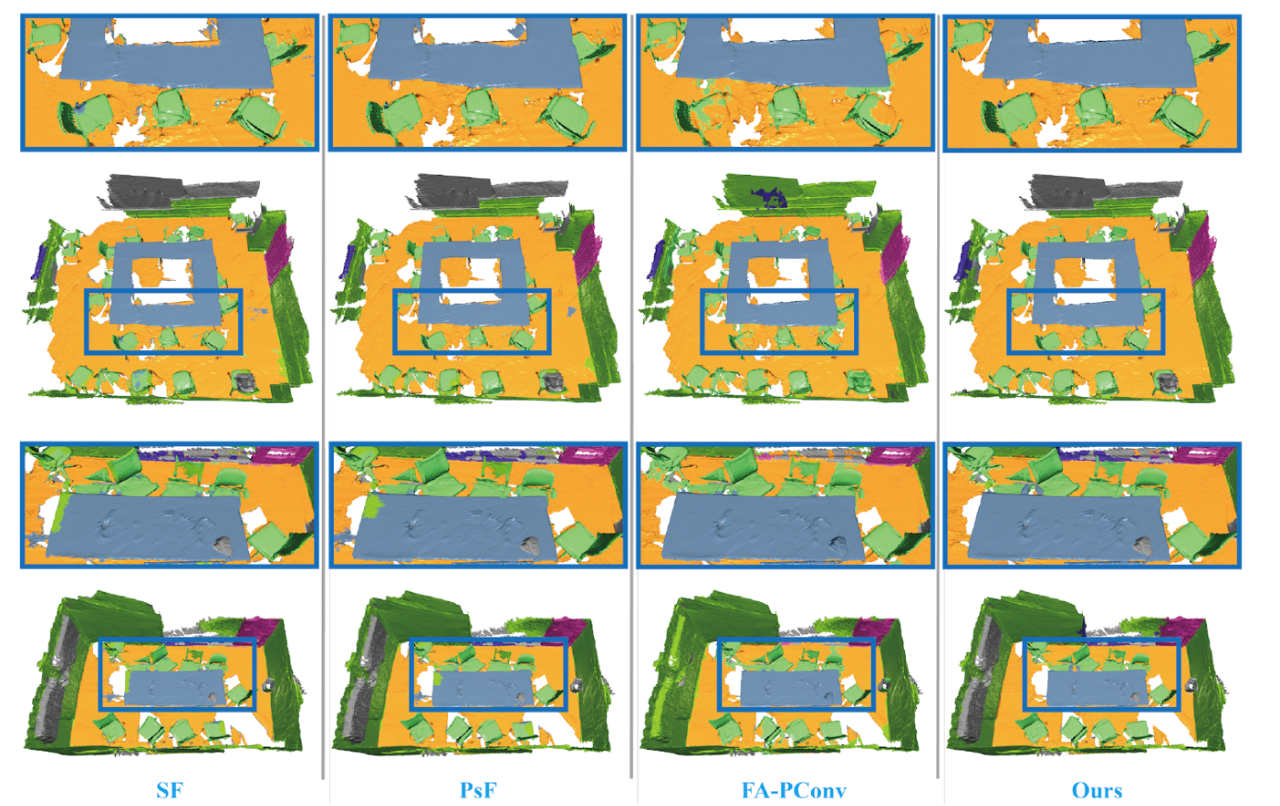

此外,图5展示了部分方法在ScanNet数据集上的语义分割的可视化比较结果。

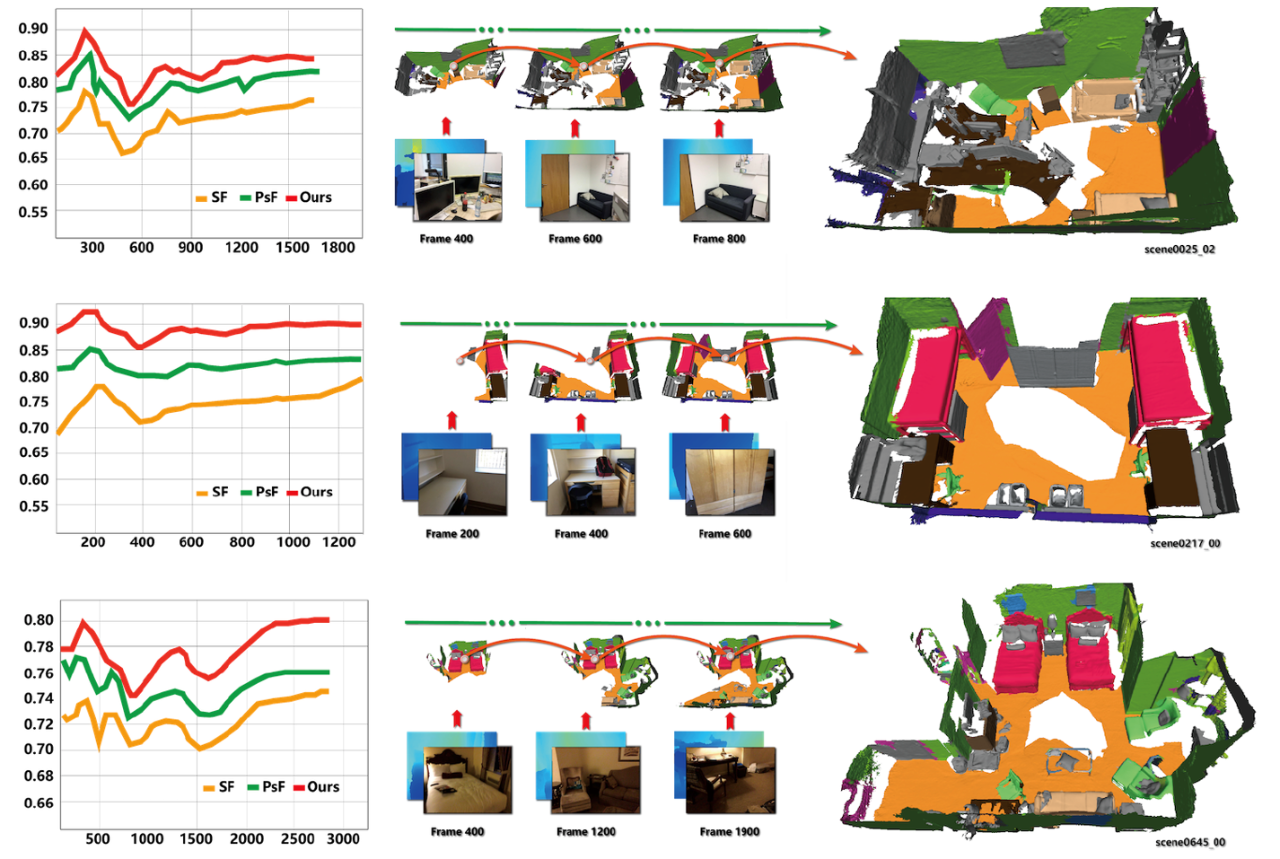

图6则展示了不同方法在在线三维语义分割过程中的准确率(mAcc和mIoU指标)曲线。从比较结果可见,本工作所提出的方法能一致性地获得更为准确的三维语义分割结果。

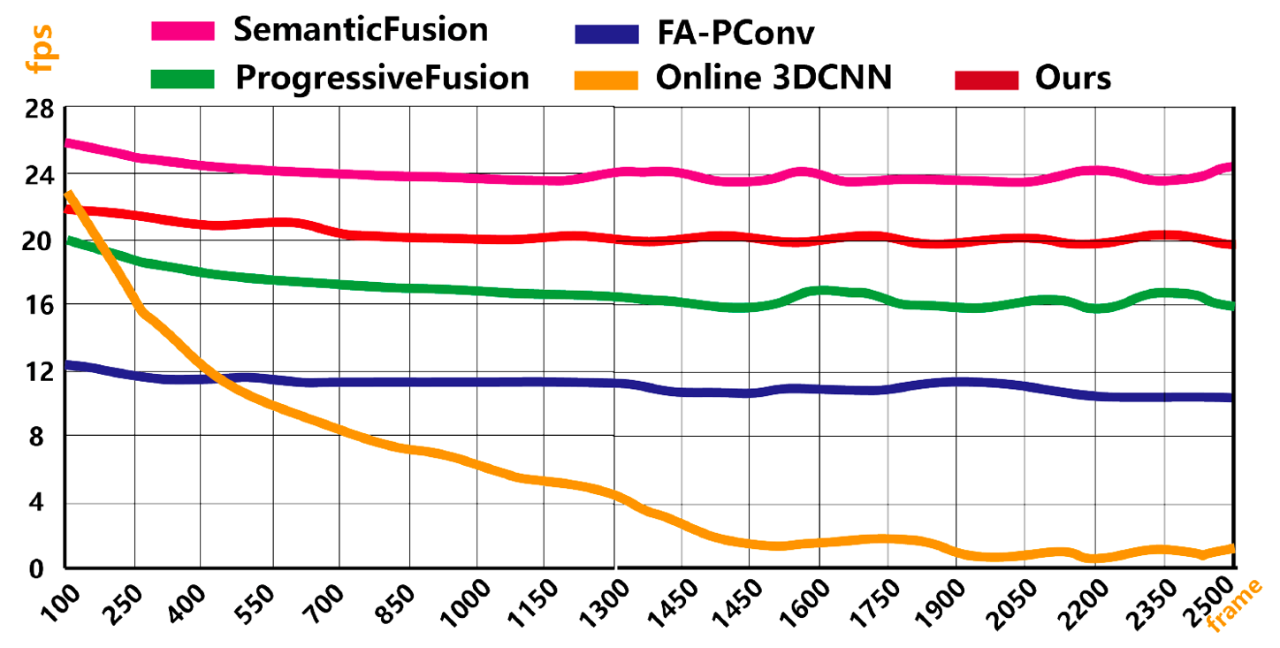

作者还对不同方法的语义预测效率进行评测,该方法可以达到平均20fps的三维语义预测效率(如图7所示),成为在效率和准确率综合权衡意义下当前最先进的方法。

论文全文,可点击“阅读原文”,在图形学实验室主页上获取。

该工作的核心模块—深度语义预测网络已在Jittor框架进行实现,开源代码请见

https://github.com/shishenghuang/SVNet_jittor。

参考文献

Shi-Sheng Huang, Ze-Yu Ma, Tai-Jiang Mu, Hongbo Fu, Shi-Min Hu, Supervoxel Convolution for Online 3D Semantic Segmentation, ACM Transactions on Graphics, 2021, Vol 40, No. 3, Article No. 34.

Matthias Nießner, Michael Zollhöfer, Shahram Izadi, and Marc Stamminger. Realtime 3D reconstruction at scale using voxel hashing, ACM Transactions on Graphics, 2012, Vol. 32, No. 6, Article No. 169, 1–11.

Abhinav Valada, Rohit Mohan, and Wolfram Burgard, Self-Supervised Model Adaptation for Multimodal Semantic Segmentation, International Journal of Computer Vision, 2020, Vol. 128, No. 5, 1239–1285.

John McCormac, Ankur Handa, Andrew J. Davison, Stefan Leutenegger, Semantic Fusion: Dense 3D semantic mapping with convolutional neural networks, ICRA 2017, 4628-4635.

Junho Jeon, Jinwoong Jung, Jungeon Kim, Seungyong Lee, SemanticReconstruction: Reconstruction of Semantically Segmented 3D Meshes via Volumetric Semantic Fusion, Computer Graphics Forum, 2018, Vol. 37, No. 7, 25-35.

Gaku Narita, Takashi Seno, Tomoya Ishikawa, Yohsuke Kaji, PanopticFusion: Online Volumetric Semantic Mapping at the Level of Stuff and Things, IROS 2019, 4205-4212.

Quang-Hieu Pham, Binh-Son Hua, Duc Thanh Nguyen, Sai-Kit Yeung, Real-Time Progressive 3D Semantic Segmentation for Indoor Scenes, WACV 2019, 1089-1098.

Jiazhao Zhang, Chenyang Zhu, Lintao Zheng, Kai Xu, Fusion-Aware Point Convolution for Online Semantic 3D Scene Segmentation, CVPR 2020, 4533-4542.

本文转自: 图形学与几何计算,转载此文目的在于传递更多信息,版权归原作者所有。如不支持转载,请联系小编demi@eetrend.com删除。