在今年的 WWDC 大会上,苹果发布了用于捕获真实世界对象的全新技术 Object Capture。Unity 一直与苹果团队进行密切合作,已将 Object Capture 引入至 Companion-to-Editor 工作流程。

自从引入苹果的移动技术,Unity 的用户已经能够轻松利用苹果最新技术来无缝地创建各类数字体验。今年下半年,Unity 的 AR Companion 应用将集成 Object Capture,让 XR 开发者能够扫描真实世界的对象并迅速生成 3D 模型。

AR Companion App 是 Unity 混合与增强现实创作工具 MARS 的智能助手应用,支持开发者在任何地点、任何 AR 设备上进行 3D 创作而无需完整的项目文件和 Unity 编辑器。我们在最初发布其之时有做过介绍(点击回看)。

一直以来,Unity 开发者面对的一个痛点是如何将变化莫测的真实世界整合到数字体验中,比如扫描空间获取实时位置信息、或将真实世界的信息融入到虚拟体验之中。Unity AR Companion 应用将创作过程延伸到了编辑器之外,提供了在现实情境中创建和捕获对象的方法。开发者可以捕捉平面、网格和其他环境信息,帮助构建 XR 应用,未来还会推出更多可以捕获的对象。

内容创作与增强现实领域将更进一步

Object Capture 项目的推出说明了创作工具的一个大趋势,即在特定硬件上结合Unity 编辑器使用 Companion 应用,这表示我们可以让每个媒介和设备都物尽其用。启用了 AR 功能的手机将成为一款优秀的设备,可以进行环境捕捉、AR 进程录制,以及新增的对象捕捉。

值得注意的是,这项新技术还支持处理现有的照片集。对使用“传统相机”设备的支持非常重要,因为它可以降低这项技术的门槛,让更广泛的受众能使用过去捕捉的图像进行摄影测量(photogrammetry)。比如你曾经为一件已经丢失的祖传物品拍摄过照片,现在有了这项技术,你就可以用 3D 形式将它再次生动地呈现出来,绽放旧日的光彩。

Object Capture 初体验

新的 Object Capture 功能内置于 iOS 版的 Unity AR Companion 应用中,后者将于今年秋天晚些时候发布。届时,我们将提供完整的文档说明。今天,我们希望先简要介绍一下相关的工作流,并探讨其中的一些想法。

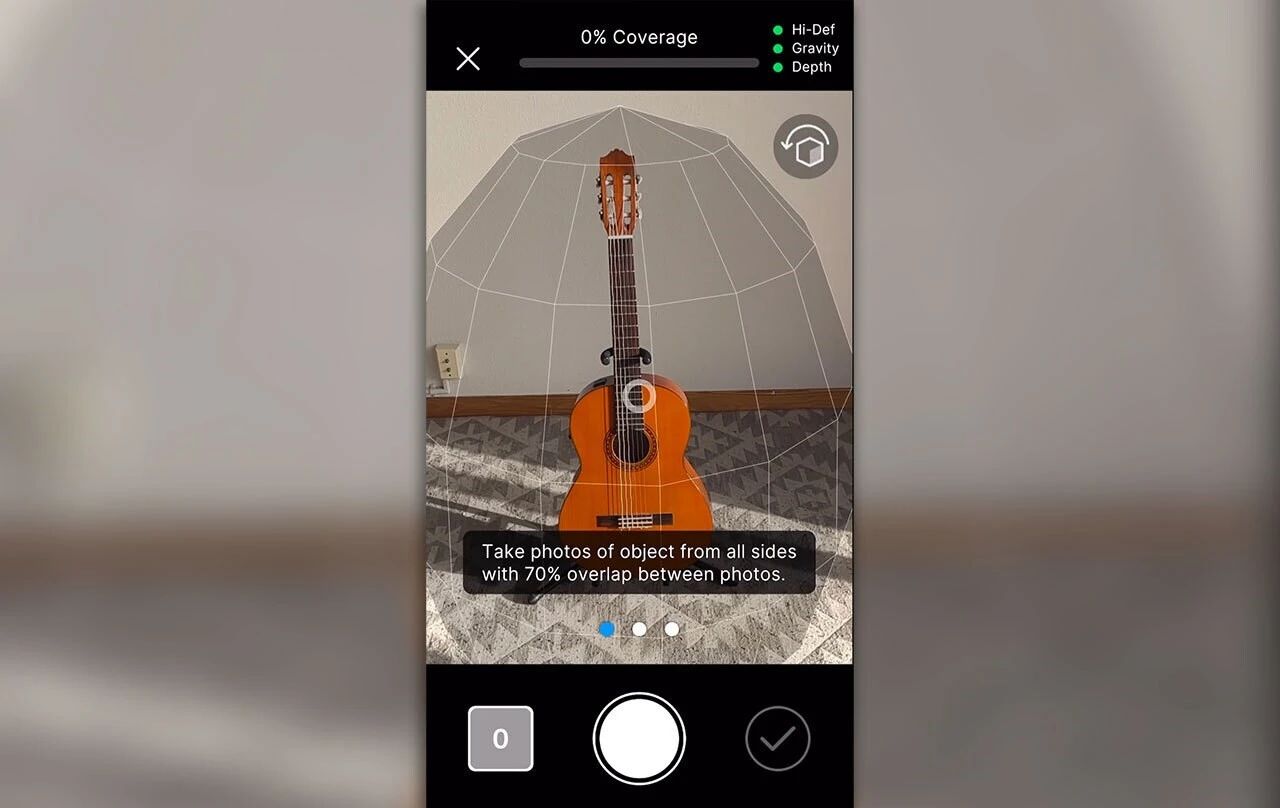

今年秋天从 AR Companion 应用开始,你会发现一个新的模式:对象捕捉(Object Capture)。

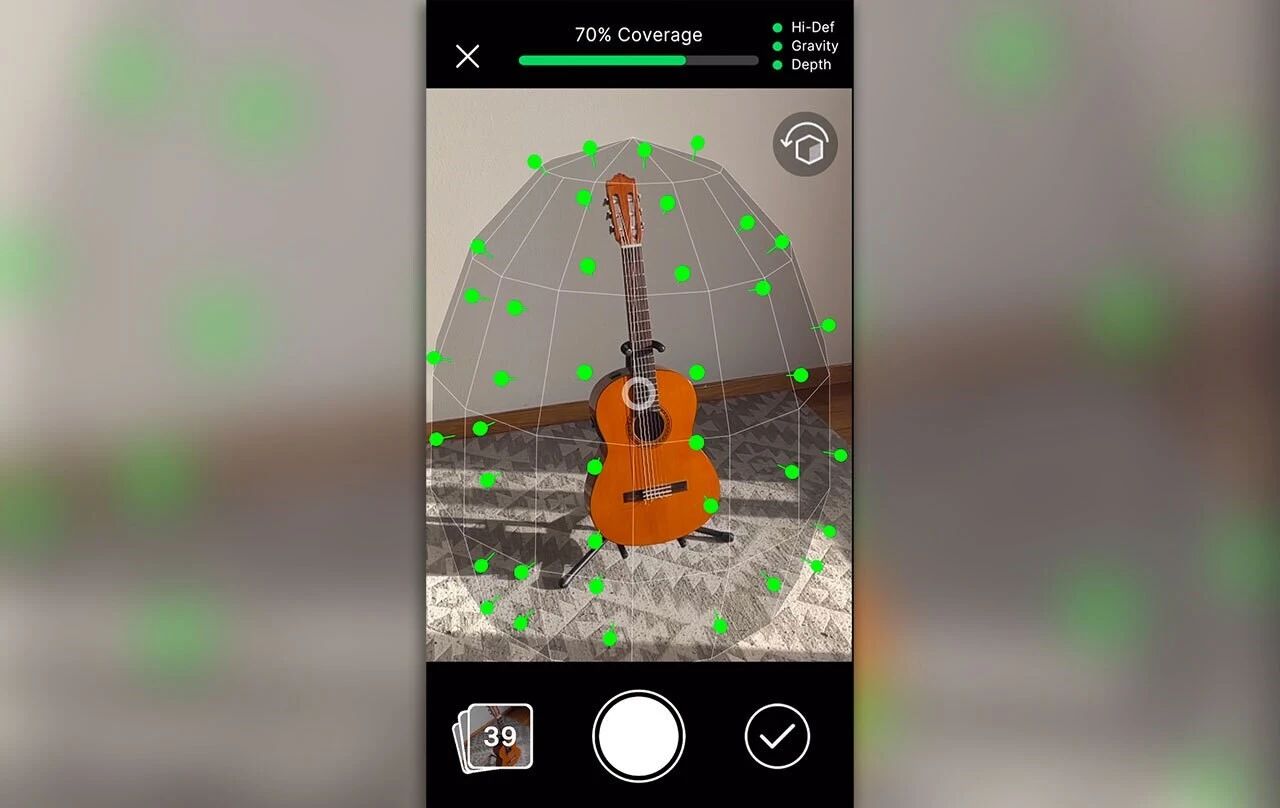

在开始拍摄照片之前,你会看到一个交互式 UI,可以为拍摄对象设置引导对象。设置完成后,就可以开始拍照了。

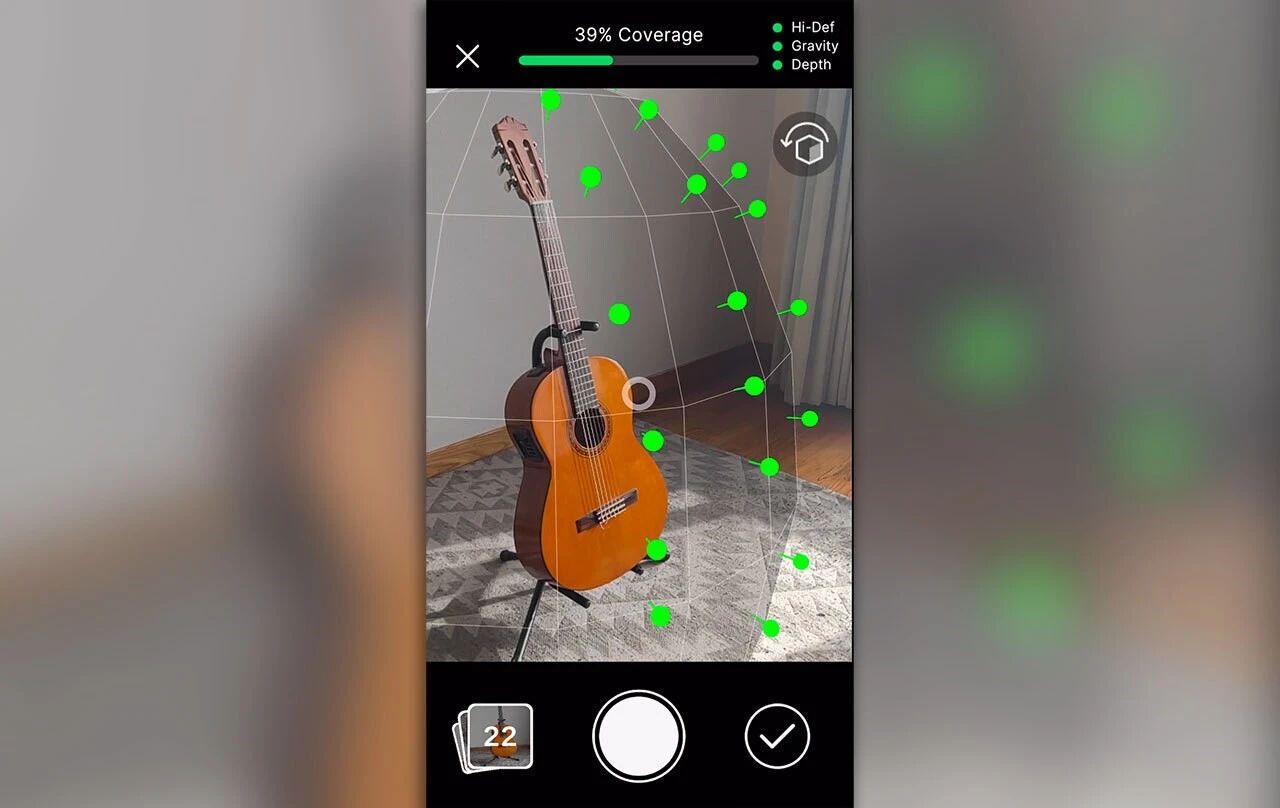

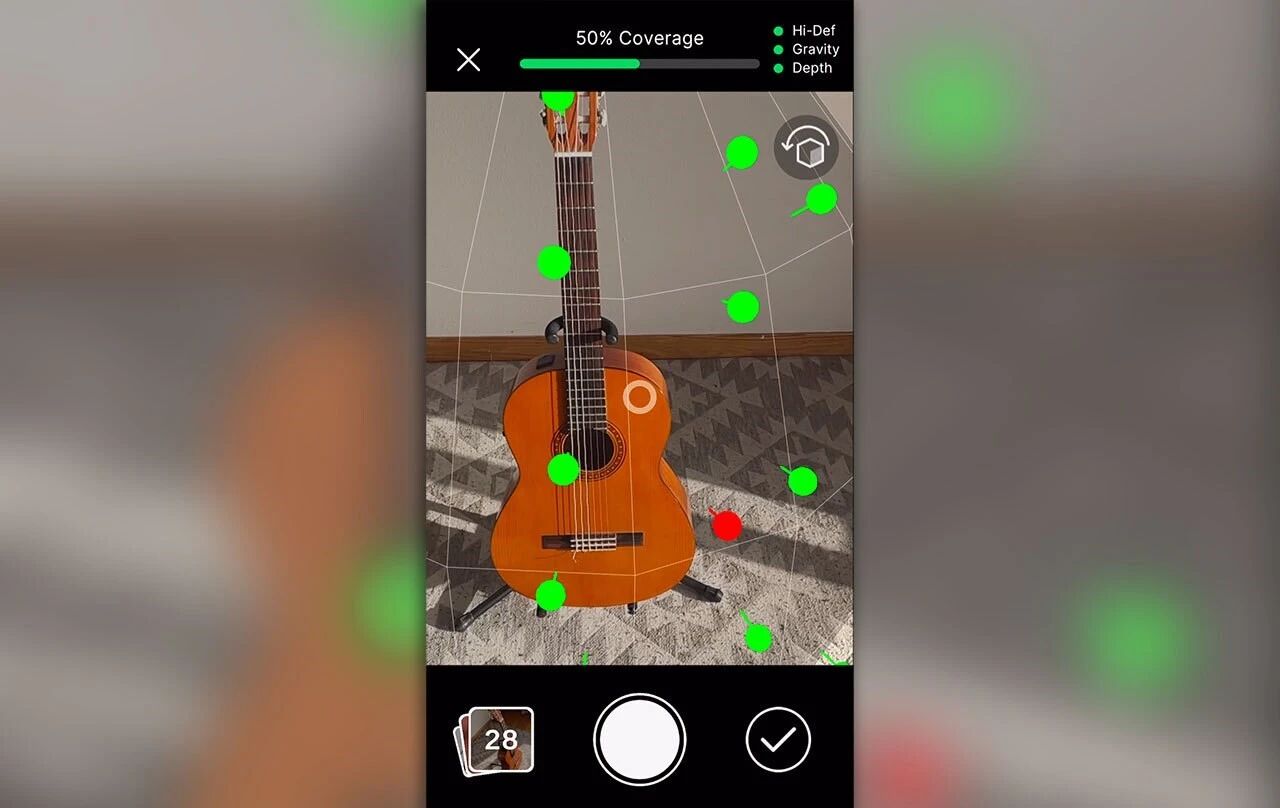

与任何摄影测量过程一样,你需要从各个角度拍摄大量的对象照片。我们会为每张照片在已经拍摄过的角度区域上放置一个“别针”进行标记。此外还可以翻转物体或调整位置,以捕捉物体的底部或悬垂的边缘。

我们将在你拍摄每一张照片时进行分析,找出可能会导致糟糕结果的低质量图像。当检测到模糊或其他不可用的照片时,系统会将“别针”标记为红色,让你能够检查、选择性地删除和重新拍摄这些照片。

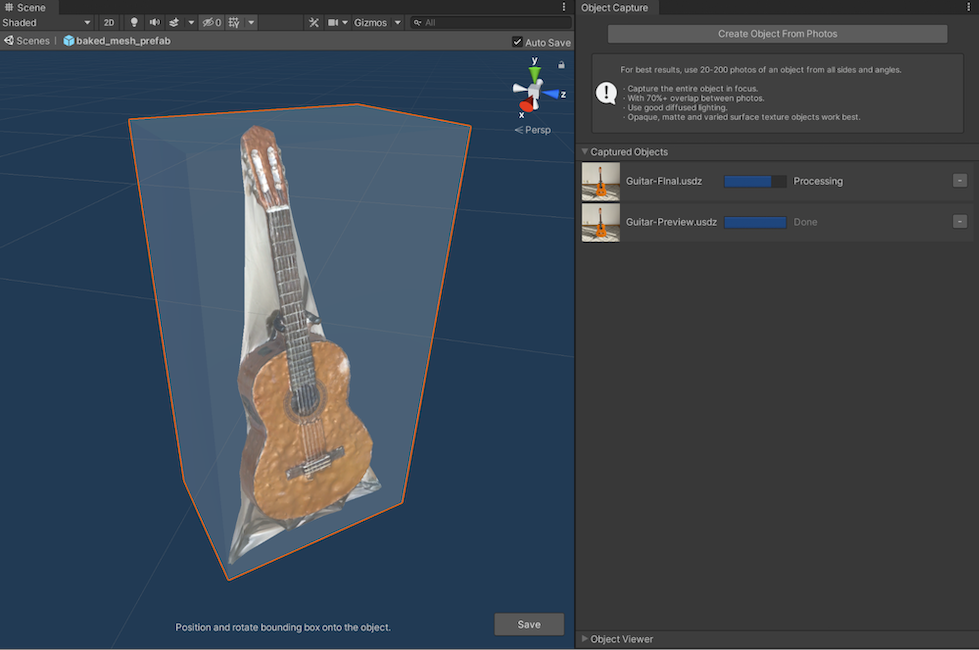

拍完所有照片后,你就可以在 Mac 端的 Unity 上处理照片、生成模型了。

我们所提供的支持有多个不同的切入点:首先,对于这个项目,我们添加了使用本地无线文件传输的功能,同时支持现有的 Companion Resources Sync 工作流。其中,“Captured Object”已添加到 Unity 现有的资源类型中,如图像标记和环境扫描。其次,我们还支持只使用本地图像目录的情况,无论是使用 iPhone 端的 Companion App 拍摄的,还是使用传统 DSLR 相机拍摄的都可支持。

无论使用哪种源文件,一旦选择了要使用的图像,你就可以立即开始处理。

这分为两个阶段:首先,处理预览质量的模型。使用预览,你可以调整边界框并进行任何必要的平移和旋转调整。

然后再点击一个按钮,系统就可以处理全质量的模型。这一步使用了预览模型中生成的大部分数据,这表示尽管模型质量更高,但第二个处理阶段所用的时间不会比预览阶段长。

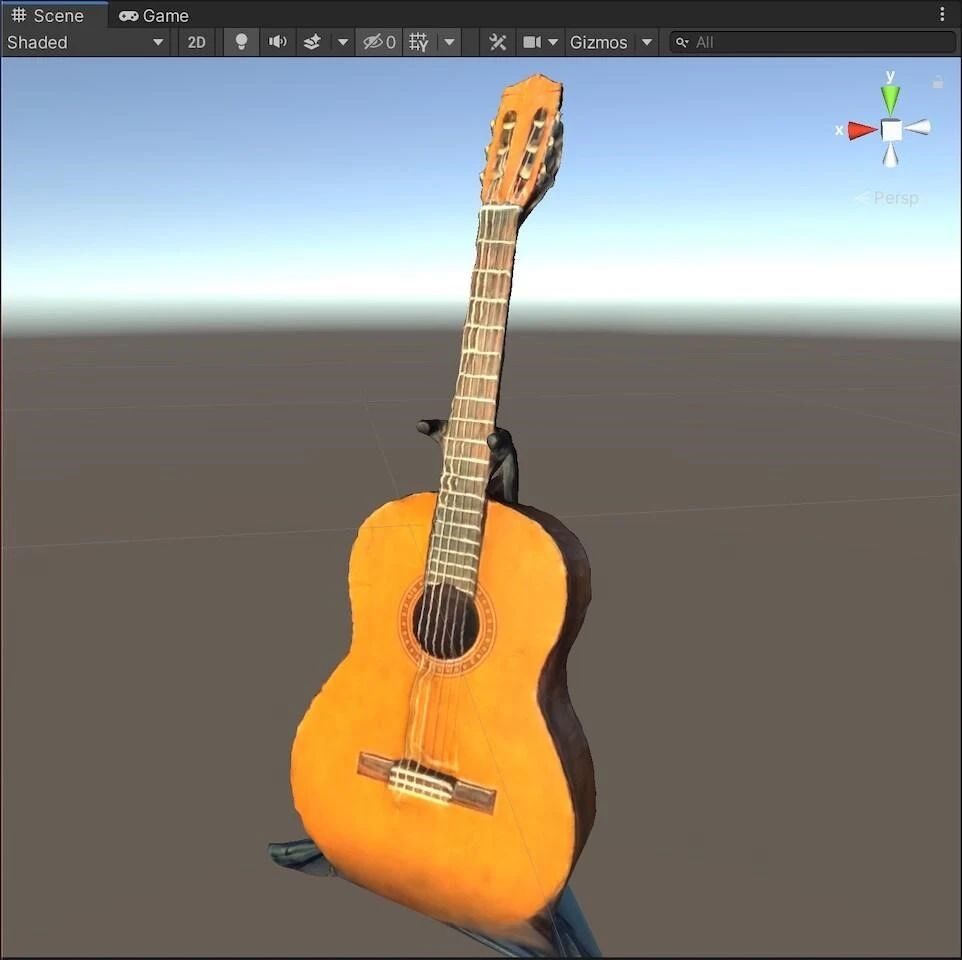

完成!你可以将最终的模型作为预制件导入到项目中,在 XR 应用中使用。

在实践中进行创作引导

在测试 Object Capture 模式的早期版本时,我们意识到这是通过 AR 来指导用户获得摄影测量最佳实践的机会。尽管第一个版本有简单的书面说明,但不少用户都不愿意细读,并会选择草草略过,因此我们添加了引导对象。

尽管引导对象不是必需的,但我们发现它对于帮助用户拍摄高质量的图像非常重要,还能清楚地显示哪些区域还没有被覆盖来最大化覆盖范围。除了引导对象,我们还添加了照片别针,可以准确提供已经拍摄过的照片角度、低质量的摄影检测和反馈等信息。

引导对象和照片别针非常有用,但它们同时引出了一个新的考量因素:因为没有追踪正在扫描的对象,所以如果对象移动,系统不能自动移动引导对象。但如果引导对象和照片别针保持在原来的位置,并且对象已经翻转,其代表的图片就不再对应。所以,我们鼓励用户在移动对象后重新放置引导对象,并重置照片别针。系统继续追踪覆盖对象的总百分比,让用户知道之前拍摄的照片没有丢失。

总而言之,我们认为这种 AR 可供性是 AR 作为辅助性教学技术的显著用例,尤其是涉及物理移动的新交互。

展望未来

这个项目让我们感到兴奋的原因有很多,首先是它与我们不断推进内容创作大众化的使命密切相关。尽管一些游戏开发者已经在制作过程中使用摄影测量很长时间了,但这是一个高度专业化并且有时让人沮丧的过程。苹果推出的 Object Capture 功能,让广大创作者能够更为轻松地使用摄影测量这一技术。我们期待看到更多创作者(如独立游戏开发者、中小型工作室、学生)能在开发过程中使用真实世界的对象捕捉功能。

但让我们更为激动的是,这个功能强大的工具集可以用于更多的日常设备上,让非专业的开发者也能进行内容创作和管理。当开始这个项目时,我们收集了这项技术涉及的一系列用例,很快意识到它影响到的领域非常广阔,不只局限于游戏。例如,一家音乐商店的店主之前只能发布一些乐器的静态图像,而现在可以使用 Object Capture 来创建逼真的、高质量的、易于共享的3D乐器模型,随时通过在线的方式或增强现实的模式进行展示。

通过将这种强大的创新技术直接集成到 Unity 工具之中,我们为非传统用户打开了摄影测量技术方便之门。策展人、建筑师、艺术家和设计师等几乎可以即时将想法付诸实践。

来源: Unity官方平台