来源:AI科技评论

编译 | 刘阳

校对 | 维克多

我们什么时候才能拥有在各方面能够模仿人脑的人工智能?专家们对这个问题意见不一。

但大家都同意的是,目前的人工智能系统与人类的智力相去甚远。直接表现是:AI只在特定任务中表现优异,无法将其能力扩展到其他领域。

例如,我们可以创造一个在星际争霸赛中击败世界冠军的程序,但这个程序在其他类型的游戏中可能连业余选手也打不过;一个经过训练的神经网络可能在X光片中发现乳腺癌“迹象”,但它却无法分辨猫和狗。

为什么会出现这种情况?数据科学家Herbert Roitblat在他的著作《 Algorithms Are Not Enough》中将AI的这种缺点归纳为:算法。具体而言,我们现在用AI处理的问题,都是可以用数学公式表示出来,并且在很大程度上能够求解此公式。

换句话说,如果我们发现了一个问题,并找到了其数学表达式,我们就可以以此创建一个人工智能算法去解决它,这种算法往往比我们自己去解决更有效率。然而,那些未被发现,以及无法用可计算的数字方式代表的问题,仍然是我们无法触及的空白领域。

当前的一些人工智能探索思路,例如“神经符号系统"、Bengio的系统2深度学习思想、LeCun提出的自监督学习等虽然取得了不错的进展,但是它们仍然涉及在预结构化空间运行,没有一个思路能解决这个空间从何而来,因此也没有解决从狭隘到一般智能的具体需求。

1、符号AI的表述

在人工智能的整个历史中,科学家们经常发明新的方法来利用计算机的进步以巧妙的方式解决问题。前几十年的人工智能侧重于符号系统。

人工智能的这一分支假定人类思维基于符号的操纵,任何能够“处理”符号的系统都是智能的。符号 AI 要求人工开发人员“仔细”定义计算机程序行为的规则、事实和结构。符号系统可以解决很多问题,如记忆信息、以超快的速度计算复杂的数学公式以及模拟专家决策。流行的编程语言和我们每天使用的大多数应用程,其基础都是符号 AI 。

但符号 AI只能局限于解决有着清晰“分步解决方案”的问题。问题是,人类和动物执行的大多数任务不能用明确的规则来表示。

"智力任务,如下棋、化学结构分析和微积分,在计算机中相对容易执行。但是有些一岁的孩子甚至是老鼠都能做到的一些活动对于计算机而言却难以做到。这被称为“Moravec’s paradox” ("莫拉韦茨的悖论"),以科学家Hans Moravec(汉斯·莫拉韦茨)的名字命名,他说,与人类相比,计算机可以用很少的算力执行高水平的推理任务,但很难执行一些人类和动物自然获得的简单技能。

数百万年来,人类大脑已经进化出机制,使我们能够执行基本的感应运动功能。我们接球,我们识别面孔,我们判断距离,一切似乎都毫不费力。

另一方面,“智力活动”是近年来才得到发展的新概念。我们经常进行大量的训练,并且非常努力的去完成各种各样的任务。那么,我们能否问这样一个问题:是能力让我们产生了智力,还是智力让我们产生了能力?

2、机器学习中的表述

因此,尽管具有非凡的推理能力,符号AI仍然与人类的表述方式紧密相连。

机器学习提供了不同的人工智能方法。无需明确的规则,而是通过实例"训练"机器学习模型。Roitblat表示:"(机器学习)系统不仅可以做“专门任务”,而且可以将其能力扩展到以前没有见过的事件,至少扩大一定范围。

最流行的机器学习形式是监督学习,其中模型接受一组输入数据(例如湿度和温度)和预期结果(例如下雨概率)的训练。机器学习模型使用此信息来微调,形成从输入映射到输出的一组参数。即使遇到以前没有见过的数据输入时,训练有素的机器学习模型也可以非常准确地预测结果。并不需要去制定明确的规则。

但是,受监督的机器学习仍然建立在人类智力提供的表述基础上,尽管这种表现比象征性的人工智能更宽松。Roitblat 这样描述受监督的学习:"机器学习涉及问题的表述时,它的解决方法是将其设置为三组数字。一组数字表示系统接收的输入,一组数字表示系统生成的输出,第三组数字表示机器学习模型。

因此,尽管受监督的机器学习并没有像符号AI那样被规则紧密的约束,但它仍然需要人类智慧所创造的严格表述。人类工程师必须定义特定问题,策划训练数据集,并在创建机器学习模型之前标记结果。只有当问题以自己的方式被严格表述时,模型才能开始调整其参数。

换句话说:表述由系统的设计者选择,在许多方面,表述是设计机器学习系统的最关键部分。

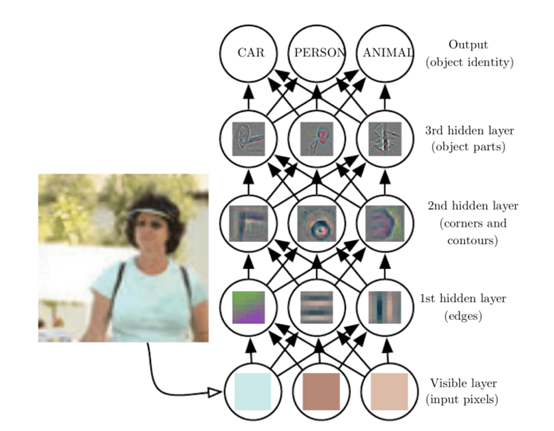

机器学习另一个分支是深度学习,常常被比作人脑,其核心是深度神经网络。深度学习模型可以执行非常复杂的任务,如对图像进行分类或转录音频

但同样,深度学习的威力在很大程度上取决于架构和表现力。大多数深度学习模型需要标记的数据,而且没有一种通用的神经网络架构可以用以解决所有可能的问题。

在构建模型的过程中,机器学习研究员必须首先定义要解决的问题,然后“找”一个大型训练数据集,然后找出能够解决该问题的深度学习架构。

在训练期间,从输入到输出,深度学习模型将调整数百万个参数。但是,它仍然需要机器学习工程师来决定神经网络的层次数和类型、学习速率、优化功能、损失功能和其他不可学习的方面。

与许多机器智能一样,深度学习的威力来自系统的设计方式,而不是来自它的自主智能。只有巧妙的表述,包括巧妙的架构,才能使机器智能变得聪明。

如果将深度学习网络描述为学习自己的表述,那就错了。网络的结构决定了它能从其输入中获得什么表述。换句话说,对于深度学习网络和任何其他机器学习系统来说,它如何表述输入以及它如何表述解决问题的过程同样具有确定性。

机器学习的其他分支也遵循相同的规则。例如,无人监督的学习不需要标记示例。但是,它仍然需要一个明确的目标,如网络安全中的异常检测、营销中的客户细分、维度降低或嵌入表示。

强化学习是机器学习的另一个流行分支,与人类和动物智力的某些方面非常相似。似乎智能体在训练时不依赖标签示例。相反,它被赋予一个环境(例如棋或棋盘)和一组它可以执行的动作(例如移动棋子,放置石头)。在每一步,agent执行一个操作,并以奖励和处罚的形式接收来自其环境的反馈。通过反复试验,强化学习智能体会发现产生更多回报的动作序列。

计算机科学家Richard Sutton(理查德·萨顿)将强化学习描述为"第一个智能计算理论"。近年来,它已成为非常流行的解决复杂的问题,如掌握计算机和棋盘游戏,并开发多功能的机械手。

但强化学习环境通常非常复杂,智能体可以执行的可能操作的数量非常大。因此,强化学习代理需要人类智力的大量帮助来设计正确的奖励、简化问题和选择正确的架构。例如掌握网络游戏DotA 2的强化学习系统OpenAI 5,就依靠其设计师简化很多游戏规则,例如减少可用其角色的数量等。

除了琐碎的系统之外,检查所有可能导致奖励的行动的所有可能组合几乎是不可能的。与其他机器学习情况一样,需要启发式系统来将问题简化为更易处理的问题,即使这样无法保证能够产生最佳答案。

这恰恰也是当前人工智能系统的缺陷:目前人工智能工作的方法,是在研究员已经想出了如何构建和简化问题的基础上开发的,以便现有的计算机和流程能够解决这些问题。要拥有真正的一般智能,计算机需要拥有能够定义和构建自己的问题的能力。

3、AI朝着正确的方向发展吗?

有各种努力来应对当前人工智能系统的挑战。一个比较流行的想法是继续扩大深度学习的规模。一般推理是,更大的神经网络最终将破解智能的“密码”。毕竟,人脑有超过100万亿个突触。谷歌人工智能研究人员开发的最大神经网络有一万亿个参数。证据表明,在神经网络中添加更多的图层和参数可以带来渐进式改进,尤其是在 GPT-3 等语言模型中更为明显。

但是,大型神经网络并不能解决一般智能的根本问题。

虽然GPT-3语言模型的重大成就,但它们不是通常意义上智能。本质上,他们只是抽象层面上的抄袭者,他们用一种语言模拟单词的顺序。给它一个提示,它会创建一个文本,但这些文本它并不像“真正的语言”一样有着彼此之间的联系。它和所有当前的人工智能应用程序一样,都是只解决了一个特定的问题。这正是它被宣传为一种语言模式而不是通常意义上的智能的原因。

其他研究方向试图为当前的人工智能结构添加结构改进。

例如,混合人工智能将符号AI和神经网络结合在一起,将前者推理能力与后者的模式识别能力相结合。混合人工智能(也称为"神经符号系统")已经有几个实际案例,表明混合系统需要的训练数据更少,在推理任务方面比纯神经网络方法更稳定。

系统2深度学习是深度学习先驱Yoshua Bengio(优舒亚·本吉奥)提出的另一个研究方向,它试图将神经网络超越统计学。系统2深度学习旨在使神经网络能够学习"高级表示",而无需明确嵌入象征性智能。

另一项研究工作是自我监督学习,由另一位深度学习先驱、卷积神经网络发明者Yann LeCun提出。自我监督的学习旨在学习任务,而不需要标记的数据。

所有这些解决方案都为(路径问题)带来了更强大的问题解决方案,但没有一个能解决这些解决方案是如何构建或生成的问题。它们仍然涉及在预结构化空间运行。没有一个能解决这个空间从何而来的问题。上述都是这些都是非常重要的想法,只是它们没有解决从狭隘到一般智能的具体需求。

因此,人工智能是一项正在进行中的工作。有些任务已经比其他任务进展得更远了,但是有些还有很长的路要走。人工智能的缺陷往往是其创造者的缺陷,而不是计算决策的内在属性。它正在随着时间的推移而进步。

相关连接:https://bdtechtalks.com/2021/03/29/ai-algorithms-representations-herbert...

本文转自:AI科技评论,转载此文目的在于传递更多信息,版权归原作者所有。如不支持转载,请联系小编demi@eetrend.com删除。